سینا ترابی

در سالهای اخیر، شاهد تکامل خیرهکننده و توسعه سریع مدلهای زبانی بزرگ (LLMها) بودهایم؛ ابزارهایی دستساز که گویی به شکلی پیامبرگونه به خزانه بیکران دانش بشری متصل شدهاند. آنها میتوانند در کسری از ثانیه منظور ما را با هر زبان و لحنی درک کنند، اقیانوسی از اطلاعات را غربال کرده و دقیقترین جواب ممکن را با قاطعیتی شگفتانگیز در اختیارمان بگذارند.

توانایی آنها تنها به گردآوری اطلاعات محدود نمیشود. نوشتن هزاران خط کد برنامهنویسی که تا همین چند سال پیش ماهها زمان میبرد، حالا در چند دقیقه ممکن شده است. اما موج این انقلاب به همینجا ختم نمیشود؛ تولید عکس، ویدیو، صدا، موسیقی، تجزیه و تحلیلهای پیچیده پزشکی و حتی صنایع نظامی… تقریباً هیچ عرصهای نمانده که این ابزارهای به ظاهر هوشمند به آن نفوذ نکرده و راندمانش را دگرگون نکرده باشند.

شاید دور از ذهنترین جایی که انتظار داشتیم مدلهای زبانی در آن بیدفاع باشند، قلمرو علوم انسانی، فلسفه و روانشناسی بود. اما دست نگه دارید! این مدلها گاهی در استدلال و منطق، از میانگین انسانها نیز پیشی میگیرند. شما امروز میتوانید به آنها نه فقط به چشم یک ابزار، بلکه به عنوان یک «حریف تمرینی» برای مباحثه، یا حتی یک همدم که با توصیههایش سعی در بهبود وضعیت روانی شما دارد، نگاه کنید.

نیمه تاریک ماه: وقتی انسان به عدد تبدیل میشود

برای اینکه دچار سوءتفاهم نشویم، همین ابتدا باید بگویم که من مخالف اقتصاد آزاد نیستم؛ اتفاقاً برعکس، طرفدار پر و پا قرص کاپیتالیسم و بازار آزاد هستم. اشتباه استراتژیک ما دقیقاً از جایی شروع میشود که دو مسئله کاملاً نامربوط را در کنار هم قرار میدهیم و میخواهیم آنها را به زور در یک معادله بگنجانیم.

سیستمهای کاپیتالیستیِ مبتنی بر داده در دنیای امروز، تنها به متغیرهای کمّیِ ورودی و خروجی (همان عرضه و تقاضا) اهمیت میدهند و از جنبههای انسانی و جامعهشناختیِ فعالیتهای خود کاملاً غافل هستند. گویی انسانها صرفاً اعدادی در ستونهای اکسل و روی کاغذند. در این سیستم، پیش از هر چیز بررسی میشود که یک محصول چقدر تولید ناخالص را افزایش میدهد. سالها بعد، تازه وقتی که عوارض ویرانگر این محصولات در جامعه سر باز کرد، دانشمندان شروع به آگاهسازی مردم میکنند؛ روشنگریهایی که خود دههها زمان میبرد و شاید هرگز نتواند ریشههای آن محصول مضر را از خاک جامعه بیرون بکشد.

بگذارید به لیست بلندبالایی از صنایعی نگاه کنیم که ظاهراً هیچ فایده بنیادینی برای تکامل ما ندارند اما هر روز با آنها درگیریم: سیگار، الکل، مواد مخدر سبک، پورنوگرافی، شبکههای اجتماعی و حالا، رویه تجاریِ هوش مصنوعی. تمام اینها صنایعی هستند که سالیانه میلیاردها دلار برای صاحبانشان ثروت میآفرینند، اما در نقطه مقابل، هزینههایی به مراتب سنگینتر با عناوینی چون هزینههای درمان، اپیدمی افسردگی، خودکشی، فروپاشی بنیان خانواده و افت شدید بهرهوری را روی دوش جامعه آوار میکنند.

مشکل اصلی اینجاست که صاحبان این صنایع، محصولاتشان را به خوبی میشناسند. آنها در همان فاز توسعه دقیقاً میدانند چه هیولایی میسازند و چه بلایی بر سر سیستم عصبی مصرفکننده میآورند. به عنوان مثال، شرکت متا (Meta) کاملاً آگاهانه و با استخدام لشکری از دانشمندان علوم شناختی و عصبشناسان، الگوریتمهایی را توسعه میدهد که سیستم پاداش (ترشح دوپامین) در مغز کاربر را بیوقفه هک و تحریک کند. فقط چند دقیقه اسکرول کردن در اینستاگرام کافی است تا شما درک خود را از گذر زمان از دست بدهید و پس از مدتی، با عوارضی چون اعتیاد، افسردگی، بیعملی و کاهش شدید تمرکز دست به گریبان شوید.

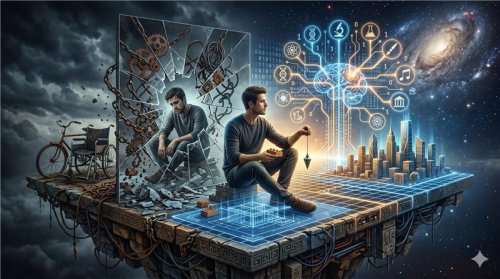

هوش مصنوعی: دوچرخهای که به ویلچر تبدیل میشود!

من در این مقاله میخواهم به عنوان یک ناظر، به شما کاربران هوش مصنوعی هشدار دهم. این ابزارها با سرعتی باورنکردنی در حال تسخیر تار و پود زندگی روزمره ما هستند؛ صدها و شاید هزاران بار سریعتر از امواج فیسبوک و اینستاگرام. مجدداً تاکید میکنم که استفاده اصولی از این ابزارها میتواند به شدت راهگشا باشد، اما این سکه روی دیگری هم دارد که در هیاهوی رسانههای امروز، عامدانه در مورد آن سکوت میشود.

مدلهای زبانی بزرگ میتوانند با کمترین زحمت، اطلاعات را جمعآوری، تجزیه و تحلیل کرده و در نهایت، پاسخ را مثل یک «فستفود فکری» یا یک لقمه آماده در دهان کاربر بگذارند. این راحتیِ اغواکننده از دو جهت به شدت خطرناک است:

یک: آتروفی (تحلیل رفتن) تفکر نقادانه ذهن انسان دقیقاً مانند یک عضله است؛ هرچه بیشتر آن را به چالش بکشید، ورزیدهتر میشود و هرچه لقمه آماده به آن بدهید، ضعیفتر و تنبلتر میگردد. زمانی که ماشینحسابها همهگیر شدند، توانایی محاسبات ذهنی انسانها به تدریج تحلیل رفت. امروز با ظهور هوش مصنوعی، همین فاجعه در ابعادی به مراتب بزرگتر برای «تفکر نقادانه» و «عمیقاندیشی» در حال وقوع است.

استیو جابز روزگاری کامپیوترها را به «دوچرخهای برای ذهن» تشبیه کرد؛ ابزاری که توان انسانی را چند برابر میکند. اما هشدار من این است: هوش مصنوعی اگر مدیریت نشود، پتانسیل این را دارد که این دوچرخهها را به «ویلچرهایی برای ذهن» تبدیل کند!

دو: توهم دانایی و قطعیت کاذب باید درک کنیم که مدلهای زبانی به منبع وحی متصل نیستند و چیزی از عدم خلق نمیکنند. آنها شبکههای پیچیدهای از همان اطلاعاتی هستند که ما انسانها در طول تاریخ تولید کردهایم. آنها در این شبکه عظیم جستجو میکنند و محتملترین کلمات را کنار هم میچینند. اما مشکل کجاست؟ اقتصاد دادهمحور و سرمایهداری برای اینکه کاربر را راضی نگه دارد، به این مدلها دستور داده تا پاسخهایی کاملاً «قطعی» و با اعتماد به نفس بالا ارائه دهند. اما در ساحت علم، ما چیزی به نام «قطعیت مطلق» نداریم. ذهن انسان پر از خطاهای شناختی است و حتی بزرگترین نوابغ تاریخ نیز از این خطاها مصون نبودهاند. تاریخ علم پر از برندگان جایزه نوبل است که سالها بعد، نتایج تحقیقات خود را حاصل خطاهای شناختی دانسته و آنها را نقض کردهاند. ما این مدلهای زبانی را با همین دادههای انسانی که آغشته به سوگیری، تعصب و خطاست آموزش دادهایم. ساختار آنها شبیه ماست و از این رو، هوش مصنوعی دقیقاً آینه تمامنمای خطاهای ماست که در ابعادی وسیعتر بازتولید میشود. توسعهدهندگان این مدلها بارها به این سوگیریها اعتراف کردهاند، هرچند پرداختن به جزئیات آن در حوصله این متن نمیگنجد.

راهکار چیست؟ عبور از انفعال

همانطور که پیشتر اشاره کردم، کاپیتالیسمِ دادهمحور باید توسط قانونگذاران مهار شود تا سلامت روان جامعه و منافع بلندمدت، فدای سودهای کوتاهمدت نگردد. هوش مصنوعی باید موظف شود از ارائه پاسخهای مطلقاً قطعی فاصله بگیرد، منابع خود را با شفافیت ذکر کند و خروجیهایش را نه به عنوان «حقیقت محض»، بلکه به عنوان «یافتههایی ابطالپذیر» ارائه دهد.

اما در سوی دیگر این میدان، مائیم؛ کاربران این ابزارها. ما هرگز نباید اجازه دهیم این تکنولوژی جایگزین فرآیند رنجآور اما سازنده «فکر کردن» شود. ما باید این مدلهای زبانی را صرفاً به عنوان دستیارانی بپذیریم که کارهای روتین را انجام میدهند. این ما هستیم که باید نقش مدیر و قاضی را ایفا کنیم. خروجی آنها وحی منزل نیست؛ ما باید با نگاهی انتقادی درستی یا نادرستی آنها را بسنجیم.

حرف آخر: معمار باشیم، نه آجرچین!

هوش مصنوعی میتواند در تحقیقات شریک ما باشد، در تفکر عمیق و مناظره به عنوان حریف تمرینی ما را به چالش بکشد، کدهایمان را بنویسد و وظایف روزمرهمان را اتوماتیک کند. اما تحت هیچ شرایطی نباید اجازه دهیم آنها «به جای ما» فکر کنند، «به جای ما» مسئله حل کنند و «به جای ما» تصمیم بگیرند.

ما باید مسئولیت سنگین اما باشکوهِ خود را بپذیریم: ما طراحان و معماران پروژهها و زندگی خود هستیم، و هوش مصنوعی تنها یک ابزار هوشمند برای آجرچینی در دستان ماست.

دیدگاه و نظرات ابراز شده در این نوشته، نظر نویسنده بوده و لزوما سیاست یا موضع نهاد مردمی را منعکس نمیکند.